Berita

Tidak semuanya membutuhkan LLM: Kerangka kerja untuk evaluasi saat itu adalah kecerdasan buatan yang logis

“Apa kebutuhan pelanggan yang membutuhkan solusi untuk kecerdasan buatan?” Tidak selalu “ya”. LLM masih mahal dan tidak selalu akurat. Baca selengkapnya

Tautan sumber

Berita

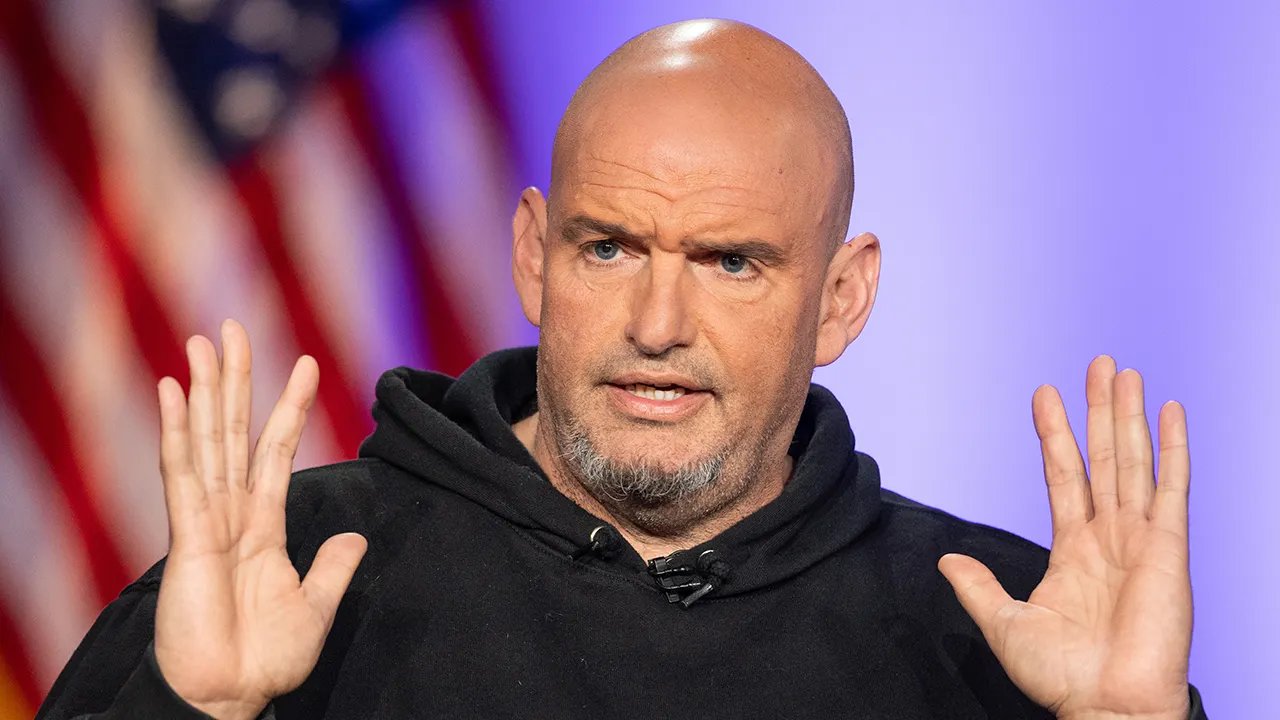

Fetterman bersedia “membayar akibatnya” untuk membuka kembali pemerintahan

baruAnda sekarang dapat mendengarkan artikel Fox News!

Senator John Fetterman, D-Pa., mengatakan kepada Hannity pada hari Rabu bahwa dia bersedia “membayar konsekuensinya” untuk membantu membuka kembali pemerintahan, bahkan jika itu berarti memutuskan hubungan dengan partainya, karena penutupan pemerintahan sudah memasuki minggu keempat.

“Saya akan selalu memilih partai saya, dan jika saya membayar harga yang sesuai dengan basis saya, itu adalah sesuatu yang ingin saya lakukan,” kata Fetterman.

Fetterman sangat vokal dalam kritiknya terhadap penutupan pemerintahan, dan berbicara tentang prioritasnya dalam mendanai militer dan Polisi Capitol dibandingkan politik partisan. Dia mencatat bahwa dia adalah satu dari hanya dua anggota Partai Demokrat yang memilih untuk mempertahankan pemerintahan tetap terbuka.

‘Saya tidak takut untuk mengatakan yang sebenarnya, dan jika saya akan membayar denda, saya tidak takut akan hal itu,’ kata Fetterman kepada pembawa acara Sean Hannity. “Menutup pemerintahan kita adalah tindakan yang salah.”

Fetterman menyerukan Partai Demokrat untuk melakukan kudeta: ‘Kami berlari untuk membunuh filibuster tersebut, dan sekarang kami menyukainya’

Senator AS John Fetterman, Demokrat dari Pennsylvania, duduk di tangga US Capitol pada 1 Oktober 2025, di Washington, D.C. (Kevin Deitch/Getty Images)

Hal ini terjadi setelah Fetterman sebelumnya menggambarkan lockdown selama 22 hari sebagai sebuah “kegagalan”. Posting ke Rabu X.

Pemangkasan program-program penting pemerintah telah menarik perhatian Partai Demokrat di Pennsylvania.

“Saya menolak memberikan suara untuk menangguhkan SNAP bagi jutaan warga Pennsylvania di negara bagian saya dan di seluruh negeri,” tegasnya.

Pemerintahan AS sedang memasuki masa penutupan terlama dalam sejarah AS dan belum terlihat akan berakhir

Jutaan warga Pennsylvania dan 42 juta orang Amerika bergantung pada makanan yang dibeli dengan bantuan dari Organisasi Kesehatan Dunia Program Bantuan Nutrisi Tambahan (SNAP)membantu keluarga berpenghasilan rendah membeli bahan makanan bergizi. Program yang sebagian besar didanai pemerintah federal ini dilaporkan diperkirakan akan dihentikan jika penutupan terus berlanjut.

“Hal itu akan ditunda karena pemerintahan kita tertutup,” kata Fetterman. “Saya tidak akan pernah bisa mendukung kerawanan pangan massal seperti ini.”

Senator John Fetterman, Demokrat dari Pennsylvania, berbicara dalam dengar pendapat dengan Komite Senat untuk Keamanan Dalam Negeri dan Urusan Pemerintahan di Capitol Hill pada 20 Mei 2025, di Washington, D.C. (Anna Penghasil Uang/Getty Images)

Senator dari Partai Demokrat itu juga mengecam apa yang disebutnya sebagai retorika “ekstremis” dari para pemimpin partai, merujuk pada penggambaran Presiden Donald Trump sebagai seorang “fasis.”

“Jenis retorika ekstremis mempermudah tindakan ekstremis semacam itu,” katanya.

“Saya menolak menjadi bagian darinya dan membandingkan orang dengan Hitler dan hal-hal lain,” tambahnya. “Jika itu yang diperlukan untuk menang, maka saya menolaknya.”

KLIK DI SINI UNTUK MENDAPATKAN APLIKASI FOX NEWS

Fetterman memperingatkan bahwa bahasa yang menghasut telah membawa negara ini ke arah yang salah, dengan mengatakan: “Kita telah kehilangan alur ceritanya.”

“Saya menolak menyebut warga saya fasis atau Nazi atau hal-hal semacam itu,” kata Fetterman. “Jika seseorang ingin mencalonkan saya di pemilihan pendahuluan atau partai ingin memilih saya, saya akan jujur dan memberi tahu Anda bahwa itu salah.”

Fetterman mendesak kedua belah pihak untuk kembali bersikap sopan dan bekerja sama, dengan mengatakan bahwa dia bersedia menahan tekanan politik jika itu berarti mempertahankan keyakinannya.

“Itu hanya dasar kemanusiaan dan kita lupa bahwa kita semua saling membutuhkan,” tutupnya.

Berita

SPLC mengajukan keluhan kepada guru Georgia atas komentar Charlie Kirk

baruAnda sekarang dapat mendengarkan artikel Fox News!

Southern Poverty Law Center telah mengajukan gugatan untuk mendukung seorang guru di Georgia yang mengatakan “dunia lebih aman tanpa dia,” mengacu pada Charlie Kirk, pendiri Turning Point USA yang dibunuh pada bulan September.

itu gugatanyang diajukan oleh SPLC dan Asosiasi Guru Georgia atas nama Michelle Mickens, seorang guru di Sekolah Menengah Oglethorpe County, menuduh bahwa hak kebebasan berbicaranya dilanggar karena memposting bahwa dunia “lebih aman” tanpa Kirk.

Menanggapi postingan yang ditulis oleh Mickens, finalis Guru Terbaik Georgia Tahun 2022 tentang Kirk, dia menulis, sesuai dengan gugatannya: “Meskipun saya sedih karena kita hidup di negara di mana kekerasan bersenjata mewabah, dunia lebih aman tanpanya. Saya sama sekali tidak menghormatinya, dan itu adalah bagian dari bahasa kebencian dan fitnah yang sering kita dengar saat ini. Saya berdoa agar tanpanya, orang-orang bisa menjadi lebih baik hati dan lebih toleran terhadap Kirk.” satu sama lain.”

Kirk, salah satu pendiri dan CEO Turning Point USA yang berusia 31 tahun, ditembak dan dibunuh pada 10 September ketika berbicara di Universitas Utah Valley selama tur comebacknya di AS.

Seorang guru di Florida mengklaim dia terpaksa menghapus poster Charlie Kirk dari kelasnya setelah seorang siswa mengeluh

Southern Poverty Law Center mengajukan pengaduan untuk mendukung seorang guru di Georgia yang mengatakan “dunia lebih aman tanpa dia,” merujuk pada pendiri Turning Point USA, Charlie Kirk, yang dibunuh pada bulan September. (Gambar Skynecher/Getty)

Pada hari Senin, SPLC dan Asosiasi Guru Georgia mengajukan gugatan, dengan tuduhan bahwa hak Amandemen Pertama Mickens telah dilanggar, dengan mengatakan bahwa “pada bulan September 2025, dia diberikan cuti tanpa batas waktu dan dibujuk untuk mengundurkan diri karena dia terlibat dalam pidato pribadi di luar tempat kerja di akun media sosial pribadinya tentang masalah yang menjadi perhatian publik.”

Gugatan tersebut menuduh bahwa mantan teman sekelas Mickens dari luar negara bagian mengambil tangkapan layar dari postingannya yang mengkritik Kirk dan kemudian mendistribusikannya secara online, yang akhirnya dibagikan ke sekolahnya.

“Postingan tersebut tidak mengganggu sekolahnya atau menimbulkan kontroversi di tempat kerjanya,” kata pengaduan tersebut. “Keputusan untuk mengeluarkan Ms. Mickens dari ruang kelasnya adalah satu-satunya gangguan terhadap operasional sekolah. Namun, Terdakwa menskorsnya dengan gaji tanpa batas waktu sambil menunggu pemutusan hubungan kerja karena pidatonya yang dilindungi undang-undang, dan meskipun mereka tidak memberikan pemberitahuan mengenai dakwaan tersebut, mereka memperjelas bahwa mereka bermaksud untuk memberhentikan pekerjaannya.”

Guru di New York diskors setelah perayaan pembunuhan Charlie Kirk: ‘Bagus sekali membuang sampah jelek’

Pada hari Senin, SPLC mengajukan pengaduan yang menuduh bahwa hak Amandemen Pertama Mickens dilanggar, dengan mengatakan bahwa “pada bulan September 2025, dia diberikan cuti tanpa batas waktu dan dibujuk untuk mengundurkan diri karena keterlibatannya dalam pidato pribadi di luar tempat kerja di akun media sosial pribadinya tentang masalah yang menjadi perhatian publik.” (Thomas Trotschl/Photothek melalui Getty Images)

SPLC berusaha untuk mengembalikan Mickens ke posisi mengajarnya, “kompensasi atas hilangnya gaji dan tunjangan, tekanan emosional, kerusakan reputasi, dan kerusakan lain yang secara langsung disebabkan oleh tindakan melanggar hukum para terdakwa,” dan untuk menutupi biaya pengacara dan biaya pengadilan.

SPLC merujuk Fox News Digital ke pernyataan dari Michael Tafelsky, wakil direktur hukum sementara di SPLC, yang mengatakan Mickens menjadi “target” karena keyakinan pribadinya.

“Kasus ini adalah tentang perlawanan terhadap meningkatnya upaya untuk melakukan kontrol ideologis atas pendidikan publik,” kata Tafelsky.

KLIK DI SINI UNTUK MENDAPATKAN APLIKASI FOX NEWS

SPLC merujuk Fox News Digital ke pernyataan dari Michael Tafelsky, wakil direktur hukum sementara di SPLC, yang mengatakan Mickens menjadi “target” karena keyakinan pribadinya.

“Ms. Mickens menjadi sasaran bukan karena dia melanggar kebijakan apa pun atau merugikan siswa, tetapi karena pandangan pribadinya – yang diungkapkan di luar kelas – tidak sejalan dengan mereka yang berkuasa,” tambah Tafelsky. “Sensor inkonstitusional atas pidato yang dilindungi ini membahayakan demokrasi yang sehat. Kami berharap dapat membela Ibu Mickens untuk memastikan dia dapat terus melayani siswanya, seperti yang telah dia lakukan selama beberapa dekade, tanpa takut akan pembalasan bermotif politik.”

Dalam sebuah pernyataan kepada Fox News Digital, Pengawas Sistem Sekolah Kabupaten Oglethorpe Beverly Levin berkata, “Distrik sekolah mengetahui gugatan ini pada Senin malam. Meskipun banyak fakta yang tercantum dalam gugatan dan siaran pers atas nama penggugat tidak akurat atau tidak lengkap, karena telah digugat di pengadilan federal, distrik lebih memilih untuk mengajukan tuntutan hukum di forum ini daripada di media atau di publik. Distrik Saya yakin dia akan menang.” Sebagai pembelaan terhadap gugatan ini.

Berita

Broderick Jones dari Steelers mengatakan dia mungkin akan menjual Aaron Rodgers lagi

baruAnda sekarang dapat mendengarkan artikel Fox News!

Tekel ofensif Pittsburgh Steelers Broderick Jones membuat marah gelandang veteran Aaron Rodgers pekan lalu setelah tekel seberat 300 pon membuat Rodgers terjatuh ke tanah dengan perayaan touchdown yang tidak biasa. Jones mengungkapkan minggu ini bahwa meskipun ada perbedaan pendapat, “tidak ada cinta yang hilang” di antara keduanya.

Namun perayaan lain dalam menangani degradasi tidak sepenuhnya mustahil, menurutnya Baja Dia membalas.

Quarterback Pittsburgh Steelers Aaron Rodgers (8) berjalan keluar lapangan setelah pertandingan sepak bola NFL melawan Cincinnati Bengals di Cincinnati Kamis, 16 Oktober 2025. (Foto AP/Caroline Custer)

“Kami masih bercanda tentang hal itu,” kata Jones kepada media, Selasa. Dia berkata: “Ya, dia sedikit marah, tapi tidak apa-apa. Ini sepak bola, dan itu menjadi intens, tapi tidak ada cinta yang hilang.”

KLIK DI SINI UNTUK CAKUPAN OLAHRAGA LEBIH LANJUT DI FOXNEWS.COM

“Itu hanya energi yang dia bawa dan saya membawanya. Dia mengatakan kepada saya, ‘Jangan kehilangan tenaga,’ dan saya mengatakan hal yang sama kepadanya. Kita lihat saja pada hari Minggu setelah dia melakukan touchdown lagi. Mungkin saya akan menjegalnya lagi.”

Rodgers, 41, terhubung dengan ketat Pat Freiermuth pada umpan touchdown 68 yard dengan waktu tersisa kurang dari tiga menit dalam pertandingan melawan Cincinnati Bengals pada Kamis malam. Perayaan berakhir ketika Jones, yang berat resminya adalah 311 pon, melompat ke arah Rodgers, membuatnya terjatuh ke tanah.

Aaron Rodgers (8) dan Broderick Jones (77) dari Pittsburgh Steelers merayakan setelah mencetak gol pada kuarter keempat melawan Cincinnati Bengals di Stadion Baycor di Cincinnati, Ohio, pada 16 Oktober 2025. (Dylan Boyle/Getty Images)

Aaron Rodgers marah setelah ditangani oleh rekan setimnya di Steelers seberat 300 pon selama perayaan touchdown

Rodgers, hanya dua tahun lagi dari cedera Achilles di akhir musim yang membuatnya absen dalam debutnya bersama New York Jets, marah ketika ia terjatuh ke lantai. Jones mencoba membantu gelandang itu berdiri sebelum Rodgers dengan cepat mendorongnya ke samping.

Tampaknya Rodgers tidak cedera akibat gangguan buruk dalam selebrasi tersebut.

Aaron Rodgers dari Pittsburgh Steelers memberikan umpan ke arah Cincinnati Bengals pada pertandingan kuarter pertama di Stadion Baycor pada 16 Oktober 2025 di Cincinnati, Ohio. (Dylan Boyle/Getty Images)

Klik di sini untuk mengunduh aplikasi FOX NEWS

Steelers kalah dari Cincinnati tetapi menghadapi mantan tim Rodgers, Green Bay Packers, pada hari Minggu. Ini adalah pertama kalinya MVP empat kali itu menghadapi Packers sejak ia diperdagangkan ke Jets pada tahun 2023.

Ikuti Fox News Digital Liputan olahraga di Xdan berlangganan Buletin Huddle Olahraga Fox News.

Berita8 tahun ago

Berita8 tahun agoThese ’90s fashion trends are making a comeback in 2017

Berita8 tahun ago

Berita8 tahun agoThe final 6 ‘Game of Thrones’ episodes might feel like a full season

Berita8 tahun ago

Berita8 tahun agoAccording to Dior Couture, this taboo fashion accessory is back

Berita8 tahun ago

Berita8 tahun agoUber and Lyft are finally available in all of New York State

Berita8 tahun ago

Berita8 tahun agoThe old and New Edition cast comes together to perform

Berita8 tahun ago

Berita8 tahun agoPhillies’ Aaron Altherr makes mind-boggling barehanded play

Bisnis8 bulan ago

Bisnis8 bulan agoMeta Sensoren Disensi Internal atas Ban Trump Mark Zuckerberg

Berita8 tahun ago

Berita8 tahun agoNew Season 8 Walking Dead trailer flashes forward in time