Berita

Microsoft meluncurkan phi-4-rasing-plus, model kecil, kuat, terbuka dan terbuka!

Bergabunglah dengan buletin harian dan mingguan untuk mendapatkan pembaruan terbaru dan konten eksklusif untuk meliput kecerdasan buatan terkemuka di industri ini. Pelajari lebih lanjut

Microsoft Research Itu mengumumkan rilis phi-4-rasing-plusModel bahasa kelas terbuka dirancang untuk tugas yang membutuhkan pemikiran yang mendalam dan terorganisir.

Bergantung pada struktur PHI-4 yang dirilis sebelumnya, model baru menggabungkan subjek pembelajaran untuk pengawasan dan penguatan untuk memberikan peningkatan kinerja pada standar dalam tugas matematika, sains, pengkodean dan logika.

PHI-4-Rasning-plus adalah model konverter yang padat dari 14 miliar pengkodean hanya mengkonfirmasi kualitas pada skala. Pelatihannya termasuk 16 miliar simbol-8,3 miliar dari mereka data buatan yang unik dan kelompok kecerdikan di Internet.

Tahap Pembelajaran Penguatan (RL), menggunakan sekitar 6400 masalah yang berfokus pada matematika, menyempurnakan kemampuan berpikir khas.

Model ini dirilis di bawah a Institut Teknologi Massachusetts -Sables Penggunaan aplikasi komersial dan institusi luas, kontrol atau distilasi, tanpa pembatasan-yang kompatibel dengan kerangka kerja inferensi yang digunakan secara luas termasuk merangkul transformator wajah, VLM, LLAMA.CP, dan Ollama.

Microsoft memberikan rekomendasi terperinci tentang parameter inferensi dan mengoordinasikan permintaan sistem untuk membantu pengembang mendapatkan manfaat maksimal dari model.

Itu melampaui model yang lebih besar

Pengembangan model mencerminkan peningkatan konsentrasi Microsoft pada pelatihan model yang lebih kecil yang mampu bersaing dengan sistem kinerja yang jauh lebih besar.

Meskipun ukurannya yang relatif sederhana, phi-4-rasioning-plus melebihi model yang lebih besar dengan bobot terbuka seperti Deepseek-R1-Distill-70B pada sejumlah standar yang sulit.

Dalam tes matematika AIME 2025, misalnya, akurasi rata-rata yang lebih tinggi ditawarkan untuk lulus semua tiga puluh pertanyaan dalam upaya pertama (pencapaian yang dikenal sebagai “lulus@1”) dari model distilasi pengemudi 70B, dan mendekati kinerja Deepseek-R1 itu sendiri, yang jauh lebih besar dalam parameter 671B.

Pemikiran terorganisir dengan pengaturan

Untuk mencapai hal ini, Microsoft menggunakan strategi pelatihan yang berfokus pada data.

Selama fase kontrol pengawasan, model ini dilatih menggunakan campuran terkoordinasi dari pemikiran sintetis yang luar biasa dan tuntutan berkualitas tinggi.

Ada salah satu inovasi utama dalam pendekatan pelatihan adalah penggunaan output pemikiran terorganisir dengan tanda khusus Simbol.

Ini adalah model untuk memisahkan langkah -langkah berpikir medium dari jawaban akhir, yang meningkatkan transparansi dan kohesi dalam menyelesaikan masalah yang lama.

Belajar penguatan untuk akurasi dan kedalaman

Setelah penyesuaian kinerja, Microsoft telah menggunakan pembelajaran berbasis hasil secara spesifik, RPO Improvement Algorithm (GRPO)-untuk meningkatkan akurasi dan efisiensi output model.

Fungsi hadiah RL dirancang untuk mencapai keseimbangan antara hak dengan realisme, menghukum pengulangan, dan memaksakan konsistensi koordinasi. Hal ini menyebabkan tanggapan yang lebih lama tetapi lebih berpikir, terutama pada pertanyaan di mana model awalnya tidak memiliki kepercayaan diri.

Pembatasan penelitian dan rekayasa yang lebih baik

PHI-4-RASING-PLUS bertujuan untuk digunakan dalam aplikasi yang mendapat manfaat dari pemikiran berkualitas tinggi di bawah batasan memori atau jintan. Ini mendukung konteks konteks 32.000 secara default dan menunjukkan kinerja yang stabil dalam pengalaman 64.000 simbol.

Lebih baik menggunakannya dalam persiapan seperti obrolan dan mengarah secara optimal dengan sistem sistem yang secara eksplisit membimbingnya ke pikiran melalui masalah selangkah demi selangkah sebelum memberikan solusi.

Pedoman Uji dan Penggunaan Keselamatan yang Luas

Microsoft memainkan formulir sebagai pencari dan komponen IQ Insteract alih -alih menyelesaikan proyeksi semua tugas muara.

Pengembang disarankan untuk mengevaluasi dengan cermat kinerja, keamanan dan keadilan sebelum menerbitkan model dalam risiko tinggi atau lingkungan terorganisir.

PHI-4-RASING-PLUS telah mengalami evaluasi keselamatan intensif, termasuk kemenangan merah oleh tim tim merah Microsoft AI dan standar dengan alat-alat seperti Toxigen untuk mengevaluasi tanggapan mereka melalui kategori konten sensitif.

Menurut Microsoft, versi ini menunjukkan bahwa melalui teknologi data dan teknologi pelatihan yang terkoordinasi dengan cermat, model kecil dapat memberikan kinerja logis yang kuat – akses demokratis terbuka ke boot.

Di bawah ini adalah versi revisi dari departemen antik yayasan dengan nada yang lebih teknis yang mirip dengan berita, sejalan dengan pos teknologi bisnis:

Efek dari pembuat keputusan teknis dari lembaga

Versi phi-4-rasing-plus dapat memberikan peluang yang signifikan bagi para pemangku kepentingan teknisi bagi lembaga yang mengelola pengembangan model kecerdasan buatan, kebetulan atau infrastruktur data.

Untuk insinyur intelijen buatan dan model manajer siklus hidup, ukuran parameter 14B model menawarkan kinerja standar kompetitif pilihan yang berlaku untuk pemikiran kinerja tinggi tanpa persyaratan infrastruktur untuk model yang jauh lebih besar. Ini memberikan kompatibilitas dengan kerangka kerja seperti Hugging Facial, VLM, Llama.cpp dan Ollama Adapters melalui cerobong asap dari berbagai lembaga, termasuk lingkungan tanpa alas kaki dan server.

Anda mungkin menemukan tim yang bertanggung jawab untuk menerbitkan model pembelajaran otomatis dan memperluas ruang lingkup dukungan mereka untuk model 32k-Ukeen-Can mencapai 64.000 dalam tes khusus dalam kasus penggunaan berat seperti analisis hukum, jaminan kualitas teknis atau pemodelan keuangan. Struktur terpadu pemisahan rantai berpikir dari jawaban akhir juga dapat menyederhanakan integrasi ke dalam fasad di mana penjelasan atau pengawasan diperlukan.

Untuk tim intelijen yang cerdas, PHI-4-eracting-plus menawarkan struktur khas yang dapat lebih mudah dibakar dalam jaringan pipa dengan pembatasan sumber daya. Ini terkait dengan skenario di mana pemikiran harus terjadi pada waktu yang sebenarnya di bawah pembatasan jintan atau biaya. Kemampuannya untuk menggeneralisasi masalah domain, termasuk NP, seperti 3SAT dan TSP, menunjukkan manfaat dalam perencanaan algoritma dan menggunakan dukungan keputusan dengan cara yang secara eksplisit melebihi yang ditargetkan selama pelatihan.

Utas rekayasa data juga dapat mempertimbangkan koordinasi pemikiran dalam model-desainer untuk mencerminkan langkah-langkah untuk menyelesaikan masalah menengah–mekanisme untuk melacak konsistensi logis melalui urutan panjang data terorganisir. Format output terstruktur dapat digabungkan menjadi lapisan verifikasi kesehatan atau sistem pendaftaran untuk mendukung klarifikasi data yang kaya data.

Dari sudut pandang tata kelola dan keselamatan, phi-4-eracting-plus mencakup beberapa lapisan keselamatan setelah pelatihan dan menjalani tes agresif oleh Microsoft International AI Red. Untuk organisasi yang tunduk pada persyaratan kepatuhan atau pengawasan, ini dapat mengurangi pengeluaran umum untuk mengembangkan fungsi penyelarasan yang dialokasikan dari titik nol.

Secara umum, PHI-4-Plus menjelaskan bagaimana kegilaan logika dimulai oleh serangkaian “O” Openai dan Deepseek R1 terus mempercepat model dan pindah ke model yang lebih kecil dan lebih mudah dan harganya terjangkau dan disesuaikan.

Untuk teknisi yang bertanggung jawab atas manajemen kinerja, ekspansi, biaya, dan risiko, ia memberikan alternatif normatif dan dapat ditafsirkan yang dapat dievaluasi dan diintegrasikan dengan basis yang fleksibel-apakah pada akhir penalaran terisolasi, alat ringkas atau sistem AI generasi penuh.

Tautan sumber

Berita

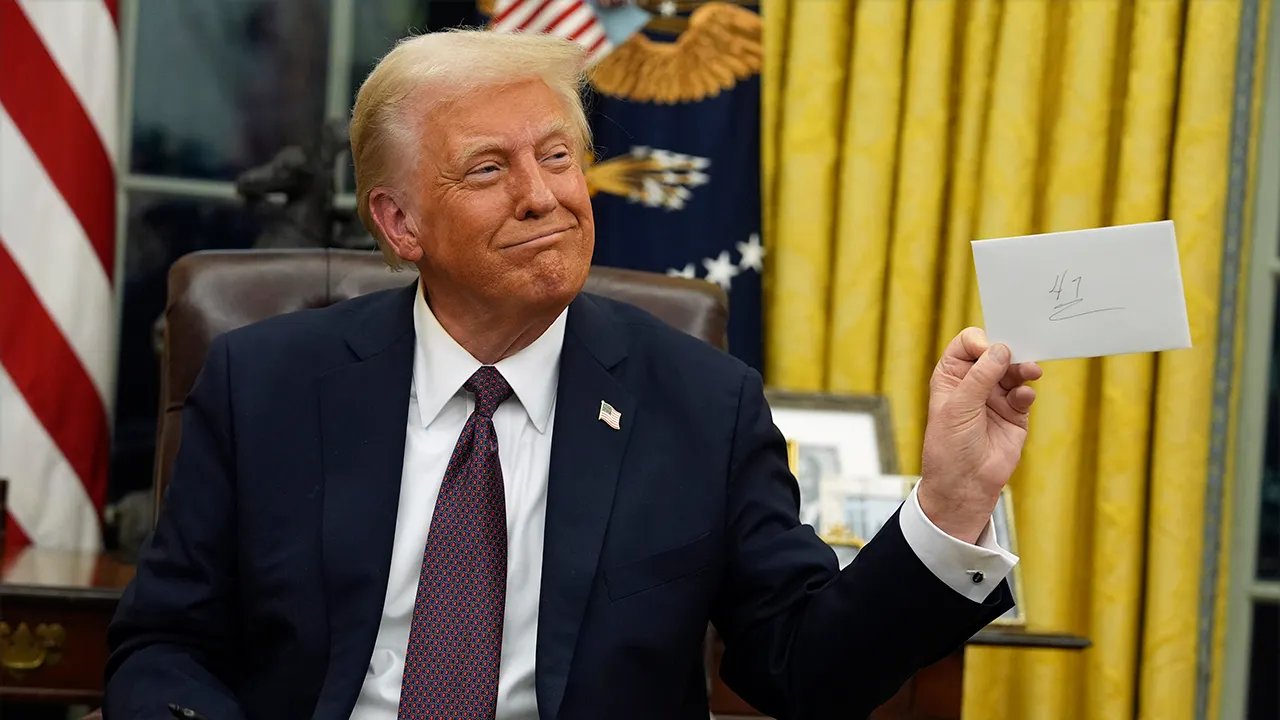

Berita tentang program Trump, seperti halnya produser TV, selalu menjadi berita utama setiap hari

baruAnda sekarang dapat mendengarkan artikel Fox News!

Hal yang perlu dipahami tentang Donald Trump adalah cara berpikirnya seperti seorang programmer.

Hal ini tidak mengherankan, mengingat latar belakang “start-up”-nya. Tapi itu juga berarti bahwa dia terkadang menelusuri ceritanya sendiri.

Kapal perang terbaru Venezuela bertujuan membalikkan keadaan dalam perang Trump melawan narkoba

Jika ini hari Jumat dan dia tidak membuat berita besar selama beberapa hari, saya tahu dia akan memberi makan pers dengan sesuatu yang menjadi makanan untuk acara akhir pekan. Dia tahu bagaimana mengisi kekosongan ini, terutama karena Partai Demokrat pada dasarnya tidak memiliki pemimpin.

Ketika presiden mendapat pujian global karena menjadi perantara gencatan senjata yang tampaknya mustahil antara Israel dan Hamas, dia akan memposting sesuatu yang liar di Truth Social yang akan menandakan dimulainya siklus berita kecil lainnya.

Percayalah, setelah mewawancarainya berkali-kali, dia mengetahui segalanya tentang pencahayaan dan sudut kamera, serta memiliki preferensi tertentu, seperti menggunakan mikrofon overhead daripada mikrofon standar. Dia pernah mengeluh kepada kru bahwa kulitnya terlihat terlalu oranye.

Presiden Donald Trump berbicara kepada wartawan di pesawat Air Force One saat ia melakukan perjalanan dari Kuala Lumpur, Malaysia, menuju Tokyo, Jepang, Senin, 27 Oktober 2025. (Mark Schiefelbein/AP)

Dia terus menolak klaim yang tidak terbukti bahwa pemilu 2020 telah dicuri, yang telah dibantah oleh Departemen Kehakiman. Dia memenangkan pemilu tahun 2024 dengan cukup mudah, dan kemudian muncul kampanye balas dendam, di mana dia menunjuk seorang loyalis yang tidak berpengalaman untuk melakukan apa yang tidak akan dilakukan orang lain, dan mengajukan tuntutan pidana terhadap James Comey dan Letitia James. Dia menyerang Joe Biden, yang kini berjuang melawan kanker, di hampir setiap pidatonya.

Dan dia melakukannya di depan umum. Berikut contoh postingannya:

“Dokumen-dokumen tersebut menunjukkan secara meyakinkan bahwa Christopher Wray, Jack Smith, Merrick Garland, Lisa Monaco, dan orang-orang jahat lainnya dari pemerintahan Biden yang gagal telah menandatangani Operasi Arctic Frost. Mereka memata-matai para senator, baik pria maupun wanita di Kongres, dan bahkan merekam seruan mereka. Mereka menipu dan mencurangi pemilihan presiden tahun 2020. Orang-orang gila sayap kiri ekstrim ini harus diadili karena perilaku mereka yang ilegal dan sangat tidak bermoral!”

Trump menjawab apakah dia akan mencalonkan diri sebagai wakil presiden pada tahun 2028

Ngomong-ngomong, saya rasa Trump tidak akan mencalonkan diri untuk masa jabatan ketiga ketika dia berusia 86 tahun di akhir masa jabatan berikutnya. Hal ini juga dilarang keras oleh Konstitusi.

Dengan menolak untuk mengesampingkan hal itu, dia pada dasarnya sedang menjebak orang. Bagaimana jika dia menggunakan manuver ini atau itu, seperti yang dipromosikan oleh Steve Bannon? Presiden mana pun juga tidak ingin dianggap sebagai orang yang tidak berdaya dan prematur.

Trump memberi tahu Anda apa yang akan dia lakukan. Dia mengatakan dia akan menghentikan program-program yang disukai oleh Partai Demokrat selama penutupan pemerintahan, dan dia melakukan hal itu. Hal ini bisa berupa transparansi (di mata para pendukungnya) atau tirani (di mata para pengkritiknya).

Bukan suatu kebetulan jika pemerintah mengumumkan bahwa SNAP, yang menjangkau 42 juta orang Amerika melalui apa yang biasa disebut kupon makanan, tidak akan lagi didanai mulai hari Sabtu.

Presiden Donald Trump bertemu dengan Sekretaris Jenderal NATO Mark Rutte di Ruang Oval Gedung Putih, Rabu 22 Oktober 2025, di Washington. (Alex Brandon/Foto AP)

Trump juga mudah marah. Dia memutuskan pembicaraan perdagangan dengan Kanada karena sebuah iklan di Ontario yang menyebutnya sebagai kecerdasan buatan palsu, sebuah sikap yang aneh bagi seorang pria yang menganggap dirinya sebagai pilot pesawat tempur yang menjatuhkan kotoran ke arah pengunjuk rasa. Selain itu, iklan tersebut secara akurat mengutip komentar anti-tarif Ronald Reagan dalam pidatonya di radio, meskipun komentar tersebut tidak sesuai.

Ketika keadaan sudah tenang, saya yakin Trump akan memperbaikinya karena dia masih ingin menjadikannya negara bagian ke-51.

Kapal perang terbaru Venezuela bertujuan membalikkan keadaan dalam perang Trump melawan narkoba

Pekan lalu, Trump melakukan dua hal yang memicu pertentangan dari beberapa sekutu tradisionalnya.

Dia menuntut $630 juta dari Kementerian Kehakiman, yang setuju dengannya, sebagai imbalan atas penderitaannya selama semua penyelidikan sebelumnya yang menghasilkan empat dakwaan yang diajukan terhadapnya. Ben Shapiro, seorang penulis dan penyiar konservatif, mengatakan ini adalah konflik kepentingan yang sangat besar dan Trump harus meninggalkan gagasan tersebut. Jika Anda melewatkan Ben Shapiro, pendiri Daily Wire, itulah perintisnya.

Presiden Donald Trump berbicara di samping Piala Pemenang Piala Dunia FIFA di Ruang Oval Gedung Putih, Jumat, 22 Agustus 2025, di Washington. (Foto AP/Jacqueline Martin)

Yang kedua adalah menghancurkan sayap timur. Cuplikan reruntuhan bagian sejarah ini terus diputar ulang di televisi.

Trump tidak jujur ketika dia mengatakan bahwa rencananya untuk sekarang, dengan pembengkakan biaya, ballroom senilai $350 juta tidak akan mencapai Sayap Timur, yang dibangun pada tahun 1902. Kemudian dia bergerak cepat dan diam-diam untuk menghancurkan seluruh gedung. Bangkai kapal adalah ceritanya. Anda tidak memerlukan panel pengacara untuk menjelaskan hal itu. Trump telah melakukan kebalikan dari janjinya. Masih sulit untuk melihatnya.

Klik di sini untuk mengunduh aplikasi FOX NEWS

Perjalanan presiden ke Asia mungkin menjadi berita utama baru selama pertemuannya dengan Presiden Tiongkok Xi Jinping. Jika tidak, dia akan mencari cara lain untuk membuat berita.

Itulah hal tentang Trump. Dia memanfaatkan megafon besar yang disediakan Gedung Putih. Dia membuat program setiap hari, membanjiri wilayah tersebut dengan begitu banyak cerita sehingga sulit bagi jurnalis dan politisi yang mencari nafkah untuk mengikutinya.

Berita

Blue Jays kembali ke Seri Dunia bahkan setelah Game 3 maraton

baruAnda sekarang dapat mendengarkan artikel Fox News!

Seri Dunia best-of-seven semuanya imbang di dua pertandingan masing-masing.

Toronto Blue Jays bangkit dari maraton 18 inning yang epik pada hari Senin untuk mengalahkan Los Angeles Dodgers 6-2 di Game 4 pada Selasa malam. Kedua tim berlari kencang setelah pertarungan hampir tujuh jam, tetapi serangan Toronto terjadi jauh di belakang Vladimir Guerrero Jr. dan Bo Bichette.

Sebuah pengorbanan dari Enrique Hernandez memberi Dodgers keunggulan awal, tetapi homer pada inning ketiga oleh Guerrero Jr. membuat Toronto unggul untuk selamanya.

KLIK DI SINI UNTUK CAKUPAN OLAHRAGA LEBIH LANJUT DI FOXNEWS.COM

Vladimir Guerrero Jr (27) dari Toronto Blue Jays bereaksi setelah melakukan dua run home run pada inning ketiga melawan Los Angeles Dodgers dalam Game 4 Seri Dunia 2025 di Stadion Dodger pada 28 Oktober 2025 di Los Angeles, California. (Ronald Martinez/Getty Images)

Blue Jays bangkit kembali hanya beberapa jam setelah bintang musik country Brad Paisley menyatakan dirinya sebagai “Tuan Moore dalam bisbol”. Penyanyi itu membawakan lagu kebangsaan sebelum maraton Game 3. Dodgers menang 6-5 melalui homer Freddie Freeman yang mengakhiri pertandingan hampir tujuh jam setelah penampilan Beasley.

Patrick Mahomes, Kevin Durant, Dak Prescott termasuk di antara bintang-bintang yang kagum pada Shohei Ohtani

Shohei Ohtani, salah satu pahlawan pascamusim Dodgers, memulai Game 4 di Los Angeles. Dia melakukan enam inning, membiarkan empat perolehan run dan enam pukulan.

Bintang dua kali ini membuat sejarah hanya satu malam yang lalu, menjadi pemain pertama sejak 1906 yang mencatat empat pukulan ekstra-base dalam pertandingan Seri Dunia dan mencapai base sembilan kali — menyamai rekor Seri.

Shohei Ohtani (17) dari Los Angeles Dodgers melakukan lemparan pada inning pertama Game 4 Seri Dunia 2025 melawan Toronto Blue Jays di Stadion Dodger pada 28 Oktober 2025 di Los Angeles, California. (Harry Cave/Getty Images)

Bo Bichette membawakan single RBI dua kali pada inning ketujuh untuk memperpanjang keunggulan Blue Jays. Shane Bieber meraih kemenangan untuk Toronto, melakukan 5 inning dan hanya mengizinkan 1 run. Ohtani didakwa atas kerugian tersebut.

Bo Bichette (11) dari Toronto Blue Jays mencetak double RBI pada inning ketujuh melawan Los Angeles Dodgers dalam Game Empat Seri Dunia 2025 di Stadion Dodger pada 28 Oktober 2025 di Los Angeles, California. (Harry Cave/Getty Images)

Dodgers hanya menggunakan tiga obat pereda setelah Ohtani keluar, sementara Blue Jays membutuhkan total empat pelempar untuk meraih kemenangan sembilan inning.

KLIK DI SINI UNTUK MENDAPATKAN APLIKASI FOX NEWS

Game 5 dijadwalkan pada hari Rabu pukul 8 malam ET di FOX sebelum seri tersebut dipindahkan kembali ke Toronto untuk Game 6.

Associated Press berkontribusi pada laporan ini.

Ikuti Fox News Digital Liputan olahraga di Xdan berlangganan Buletin Huddle Olahraga Fox News.

Berita

Model Granite 4.0 Nano AI open source IBM cukup kecil untuk dijalankan secara lokal langsung di browser Anda

Dalam industri di mana ukuran model sering dipandang sebagai proksi kecerdasan, IBM memetakan jalur yang berbeda — jalur nilai Efisiensi melebihi besarnyaDan Aksesibilitas atas abstraksi.

Raksasa teknologi berusia 114 tahun Empat model baru Granite 4.0 Nanoyang dirilis hari ini, berkisar dari hanya 350 juta hingga 1,5 miliar parameter, hanya sebagian kecil dari ukuran sepupu mereka yang terikat server seperti OpenAI, Anthropic, dan Google.

Model-model ini dirancang agar mudah diakses: varian 350M dapat dijalankan dengan nyaman pada CPU laptop modern dengan RAM 8-16 GB, sedangkan model 1,5B biasanya memerlukan GPU dengan setidaknya VRAM 6-8 GB untuk kelancaran kinerja – atau sistem yang memadai dan peralihan RAM untuk inferensi khusus CPU. Hal ini membuatnya cocok bagi pengembang yang membangun aplikasi pada perangkat konsumen atau edge, tanpa bergantung pada komputasi awan.

Faktanya, yang terkecil dapat berjalan secara lokal di browser web Anda, yang juga dikenal sebagai Joshua Lochner Zenovapencipta Transformer.js dan insinyur pembelajaran mesin di Hugging Face, menulis di jejaring sosial X.

Semua model Granite 4.0 Nano dirilis di bawah lisensi Apache 2.0 – Ideal untuk digunakan oleh peneliti dan pengembang independen, bahkan untuk penggunaan komersial.

Ini secara asli kompatibel dengan llama.cpp, vLLM, dan MLX dan disertifikasi berdasarkan ISO 42001 untuk Pengembangan AI yang Bertanggung Jawab – sebuah standar yang dipelopori oleh IBM.

Namun dalam kasus ini, ukuran yang lebih kecil tidak berarti kapasitasnya lebih kecil, itu mungkin hanya berarti desain yang lebih cerdas.

Model tertanam ini tidak dirancang untuk pusat data, namun untuk perangkat edge, laptop, dan inferensi lokal, di mana komputasi merupakan hal yang langka dan waktu respons merupakan hal yang penting.

Meskipun ukurannya kecil, model Nano menunjukkan hasil rekor yang menyaingi atau bahkan melampaui performa model yang lebih besar dalam kategori yang sama.

Peluncuran ini merupakan sinyal bahwa batas baru bagi AI mulai terbentuk dengan cepat, yang tidak didominasi oleh skala semata, namun oleh Ukuran strategis.

Apa sebenarnya yang dirilis IBM?

itu Granit 4.0 nano Keluarga ini menyertakan empat templat sumber terbuka yang sekarang tersedia di Pelukan wajah:

Granit-4.0-H-1B (~1,5 miliar parameter) – Arsitektur Hybrid-SSM

Granit-4.0-H-350M (~350 juta parameter) – Arsitektur Hybrid-SSM

Granit-4.0-1B – Varian berbasis transformator, jumlah parameter mendekati 2B

Granit – 4,0-350 m – Varian berbasis transformator

Model Seri H – Granite-4.0-H-1B dan H-350M – menggunakan hybrid state space architecture (SSM) yang menggabungkan efisiensi dengan kinerja bertenaga, ideal untuk lingkungan terminal latensi rendah.

Sementara itu, varian adaptor standar — Granite-4.0-1B dan 350M — memberikan kompatibilitas yang lebih luas dengan alat seperti llama.cpp, yang dirancang untuk kasus penggunaan yang belum mendukung arsitektur hibrid.

Dalam praktiknya, model switch 1B lebih mendekati parameter 2B, namun kinerjanya sejalan dengan saudara hybridnya, sehingga menawarkan fleksibilitas kepada pengembang berdasarkan batasan waktu proses mereka.

Varian hybrid sebenarnya adalah model 1B. Namun varian non-hybrid lebih mendekati 2B, namun kami memilih untuk tetap konsisten nomenklaturnya dengan varian hybrid agar keterkaitannya mudah terlihat, jelas Emma, manajer pemasaran produk Granite, saat konferensi. reddit "Tanyakan padaku apa saja" Sesi AMA di r/LocalLLaMA.

Kelas kompetitif model kecil

IBM memasuki pasar yang ramai dan berkembang pesat untuk model bahasa kecil (SLM), bersaing dengan penawaran seperti Qwen3, Gemma Google, LFM2 LiquidAI, dan bahkan model Mistral yang padat dalam ruang parameter sub-2B.

Meskipun OpenAI dan Anthropic fokus pada model yang memerlukan cluster GPU dan optimasi inferensi canggih, keluarga Nano IBM ditujukan khusus untuk pengembang yang ingin menjalankan kursus LLM berkinerja tinggi pada perangkat keras lokal atau perangkat keras terbatas.

Dalam pengujian benchmark, model IBM baru secara konsisten menduduki peringkat teratas di kelasnya. Menurut data Dibagikan di X oleh David Cox, Wakil Presiden AI Modeling di IBM Research:

Di IFEval (mengikuti instruksi), Granite-4.0-H-1B mendapat skor 78,5, mengalahkan Qwen3-1.7B (73,1) dan model 1–2B lainnya.

Pada BFCLv3 (Function/Tool Call), Granite-4.0-1B memimpin dengan skor 54,8, tertinggi di kelas ukurannya.

Dalam hal standar keselamatan (SALAD dan AttaQ), model Granit memperoleh skor lebih dari 90%, mengalahkan pesaing berukuran sama.

Secara keseluruhan, Granite-4.0-1B mencapai rata-rata terdepan dalam benchmark sebesar 68,3% di bidang pengetahuan umum, matematika, kode, dan keselamatan.

Performa ini sangat penting mengingat keterbatasan perangkat keras yang dirancang untuk model ini.

Ini memerlukan lebih sedikit memori, berjalan lebih cepat pada CPU atau perangkat seluler, dan tidak memerlukan infrastruktur cloud atau akselerasi GPU untuk memberikan hasil yang dapat digunakan.

Mengapa ukuran model masih penting – hanya saja tidak seperti dulu

Pada gelombang pertama MBA, lebih besar berarti lebih baik – lebih banyak parameter diterjemahkan ke dalam generalisasi yang lebih baik, pemikiran yang lebih dalam, dan hasil yang lebih kaya.

Namun seiring dengan semakin matangnya penelitian transformator, menjadi jelas bahwa arsitektur, pelatihan berkualitas, dan penyetelan khusus misi dapat memungkinkan model yang lebih kecil untuk melampaui kelas bobotnya.

IBM mengandalkan perkembangan ini. Dengan meluncurkan model terbuka kecil Kemampuan untuk bersaing dalam tugas dunia nyataperusahaan menawarkan alternatif terhadap AI API monolitik yang mendominasi tumpukan aplikasi saat ini.

Faktanya, model nano memenuhi tiga kebutuhan yang semakin penting:

Fleksibilitas penerapan — Bekerja di mana saja, mulai dari perangkat seluler hingga server kecil.

Kesimpulan privasi — Pengguna dapat menyimpan data secara lokal tanpa harus terhubung ke API cloud.

Keterbukaan dan kemampuan audit – Kode sumber dan bobot model tersedia untuk umum di bawah lisensi terbuka.

Respon masyarakat dan sinyal peta jalan

Tim Granit IBM tidak hanya meluncurkan model dan menariknya; Komunitas Reddit sumber terbuka r/LocalLLaMA Untuk berhubungan langsung dengan pengembang.

Dalam thread bergaya AMA, Emma (Pemasaran Produk, Granit) menjawab pertanyaan teknis, mengatasi kekhawatiran tentang konvensi penamaan, dan memberikan petunjuk tentang langkah selanjutnya.

Konfirmasi penting dari topik:

Model Granit 4.0 yang lebih besar saat ini sedang dalam pelatihan

Model yang fokus pada inferensi ("Rekan-rekan mereka dalam berpikir") sedang dalam persiapan

IBM akan segera merilis resep penyesuaian dan makalah pelatihan lengkap

Lebih banyak alat dan kompatibilitas platform sedang dalam rencana

Pengguna merespons dengan antusias kemampuan model, terutama dalam tugas mengikuti instruksi dan respons terstruktur. Seorang komentator menyimpulkannya dengan mengatakan:

“Ini merupakan hal yang besar jika diterapkan pada model 1B – jika kualitasnya bagus dan menghasilkan output yang konsisten. Tugas pemanggilan fungsi, dialog multibahasa, penyelesaian FIM…ini bisa menjadi pekerjaan yang sangat sulit.”

Pengguna lain berkomentar:

“Granit Tiny sebenarnya adalah pilihan favorit saya untuk penelusuran web di LM Studio – lebih baik daripada beberapa model Qwen. Saya mungkin tergoda untuk mencoba Nano.”

Latar Belakang: IBM Granite dan perlombaan AI perusahaan

Dorongan IBM ke dalam model bahasa besar dimulai dengan sungguh-sungguh pada akhir tahun 2023 dengan debut keluarga model perusahaan Granite, dimulai dengan model seperti Granit.13b.instruksikan Dan Granit.13B.Obrolan. Dirilis hanya untuk digunakan dalam platform Watsonx, prototipe khusus dekoder ini menandakan ambisi IBM untuk membangun sistem AI tingkat perusahaan yang memprioritaskan transparansi, efisiensi, dan kinerja. Perusahaan mengambil sampel kode Granite secara open source di bawah lisensi Apache 2.0 pada pertengahan tahun 2024, sehingga meletakkan dasar bagi adopsi yang lebih luas dan eksperimen pengembang.

Titik balik sebenarnya datang dengan Granite 3.0 pada bulan Oktober 2024, rangkaian model tujuan umum dan khusus domain yang sepenuhnya open source mulai dari parameter 1B hingga 8B. Model ini berfokus pada efisiensi dalam skala besar, menawarkan kemampuan seperti jendela konteks yang lebih panjang, penyesuaian instruksi, dan pagar pembatas yang terintegrasi. IBM telah memposisikan Granite 3.0 sebagai pesaing langsung Llama dari Meta, Qwen dari Alibaba, dan Gemma dari Google — namun dengan sudut pandang unik yang mengutamakan perusahaan. Rilis yang lebih baru, termasuk Granite 3.1 dan Granite 3.2, memperkenalkan inovasi yang lebih ramah perusahaan: deteksi halusinasi bawaan, perkiraan rangkaian waktu, model visibilitas dokumen, dan inferensi bersyarat.

Keluarga Granite 4.0, yang diluncurkan pada Oktober 2025, mewakili rilis IBM yang paling ambisius secara teknis hingga saat ini. Ini memperkenalkan arsitektur hibrida yang menggabungkan lapisan transformator dan lapisan Mamba-2 – yang bertujuan untuk menggabungkan akurasi kontekstual dari mekanisme perhatian dan efisiensi memori model ruang keadaan. Desain ini memungkinkan IBM untuk secara signifikan mengurangi biaya memori dan latensi inferensi, menjadikan model Granite dapat digunakan pada mesin yang lebih kecil sambil tetap mengungguli rekan-rekan mereka dalam tugas tindak lanjut instruksi dan panggilan fungsi. Peluncuran ini juga mencakup sertifikasi ISO 42001, penandatanganan model kriptografi, dan distribusi di seluruh platform seperti Hugging Face, Docker, LM Studio, Ollama, dan watsonx.ai.

Di seluruh iterasi, fokus IBM sudah jelas: membangun model AI yang dapat dipercaya, efisien, dan tidak ambigu secara hukum untuk kasus penggunaan perusahaan. Dengan lisensi Apache 2.0 yang permisif, standar umum, dan fokus pada tata kelola, Granit Initiative tidak hanya menanggapi kekhawatiran yang berkembang tentang model kotak hitam yang dipatenkan, namun juga menawarkan alternatif terbuka dan selaras dengan Barat terhadap kemajuan pesat yang dicapai oleh tim seperti Alibaba’s Coin. Dengan melakukan hal ini, Granite memposisikan IBM sebagai pemimpin dalam fase selanjutnya dari AI yang siap produksi dan berbobot terbuka.

Pergeseran menuju efisiensi yang terukur

Pada akhirnya, peluncuran model Granite 4.0 Nano oleh IBM mencerminkan perubahan strategis dalam pengembangan LLM: dari mengejar catatan jumlah parameter hingga meningkatkan kemudahan penggunaan, keterbukaan, dan skala penerapan.

Dengan menggabungkan kinerja kompetitif, praktik pengembangan yang bertanggung jawab, dan keterlibatan mendalam dengan komunitas sumber terbuka, IBM memposisikan Granite tidak hanya sebagai rangkaian model — namun sebagai platform untuk membangun sistem AI generasi berikutnya yang ringan dan dapat dipercaya.

Bagi pengembang dan peneliti yang mencari performa tanpa biaya tambahan, Edisi Nano menawarkan sinyal yang menarik: Anda tidak memerlukan 70 miliar parameter untuk membangun sesuatu yang hebat — cukup parameter yang tepat.

Berita8 tahun ago

Berita8 tahun agoThese ’90s fashion trends are making a comeback in 2017

Berita8 tahun ago

Berita8 tahun agoThe final 6 ‘Game of Thrones’ episodes might feel like a full season

Berita8 tahun ago

Berita8 tahun agoAccording to Dior Couture, this taboo fashion accessory is back

Berita8 tahun ago

Berita8 tahun agoUber and Lyft are finally available in all of New York State

Berita8 tahun ago

Berita8 tahun agoThe old and New Edition cast comes together to perform

Bisnis9 bulan ago

Bisnis9 bulan agoMeta Sensoren Disensi Internal atas Ban Trump Mark Zuckerberg

Berita8 tahun ago

Berita8 tahun agoPhillies’ Aaron Altherr makes mind-boggling barehanded play

Berita8 tahun ago

Berita8 tahun agoNew Season 8 Walking Dead trailer flashes forward in time