Berita

Berapa informasi yang benar -benar menghafal LLMS? Sekarang kami tahu, terima kasih kepada Meta, Google, Nvidia dan Cornell

Bergabunglah dengan buletin harian dan mingguan untuk mendapatkan pembaruan terbaru dan konten eksklusif untuk meliput kecerdasan buatan terkemuka di industri ini. Pelajari lebih lanjut

Kebanyakan orang yang tertarik pada AI sudah tahu bahwa model bahasa besar (LLM) – seperti yang ada di belakang chatgpt, Claude’s Claude, dan Google Gemini – dilatih dalam koleksi data besar: triliun kata yang ditarik dari situs web, buku, pintu kode, semakin, dan mode lain seperti gambar, video dan video. Tapi kenapa?

Dari data ini, LLMS mengembangkan pemahaman statistik dan umum tentang bahasa dan polanya dan dunia – dienkripsi dalam bentuk miliaran parameter, atau “pengaturan”, dalam jaringan neuron buatan (yang merupakan fungsi matematika yang mengubah data input menjadi sinyal output).

Dengan paparan semua data pelatihan ini, LLMS belajar untuk menemukan dan menggeneralisasi pola yang tercermin dalam parameter sel saraf mereka. Misalnya, kata “apel” sering muncul di dekat istilah yang terkait dengan makanan, buah atau pohon, dan kadang -kadang komputer. Model mengambil bahwa apel bisa merah, hijau, atau kuning, atau bahkan kadang -kadang warna lain jika rusak atau langka, “apel” dalam bahasa Inggris, dan dimakan. Pengetahuan statistik ini memengaruhi bagaimana formulir merespons ketika pengguna memasuki seorang mentor – pembentukan output yang membuatnya berdasarkan tautan yang Anda “pelajari” dari data pelatihan.

Tetapi pertanyaan besar tetap ada – bahkan di antara para peneliti kecerdasan buatan -: berapa banyak data pelatihan LLM yang digunakan untuk konstruksi Digeneralisasi Representasi konsep, dan seberapa banyak itu menyimpan Secara harfiah atau dengan cara yang identik atau hampir identik dengan data asli?

Ini penting tidak hanya untuk lebih memahami cara kerja LLMS – dan ketika mereka membuat kesalahan – tetapi juga sebagai model, mereka mempertahankan diri dalam mengklaim hak cipta yang disajikan oleh pencipta data dan pemiliknya, seperti seniman dan tanda -tanda rekaman. Jika ternyata LLMS untuk mereproduksi sebagian besar data pelatihan mereka secara harfiah, pengadilan mungkin lebih cenderung mendukung dengan jaksa penuntut yang membahas bahwa model yang telah disalin secara ilegal dari bahan yang dilindungi. Jika tidak – jika model ditemukan untuk membuat output berdasarkan pola umum alih -alih salinan simetris yang akurat – pengembang mungkin dapat melanjutkan pengikis dan pelatihan data hak cipta sehubungan dengan pertahanan hukum saat ini seperti penggunaan yang adil.

Sekarang, kami akhirnya memiliki jawaban untuk masalah perlindungan LLMS untuk generalisasi: Sebuah studi baru yang dikeluarkan minggu ini Dari para peneliti di Meta, Google DeepMind, Universitas Cornell dan Nvidia menemukannya Model yang mirip dengan GPT memiliki kapasitas hemat tetap sekitar 3,6 bit untuk setiap guru.

Untuk memahami apa arti 3,6 bit dalam praktik:

- Satu bagian adalah unit data digital terkecil, mewakili 0 atau 1.

- Penyimpanan 3.6 bit memungkinkan sekitar 12,13 nilai khas, sebagaimana dihitung oleh 2^3.6.

- Itu datang ke jumlah informasi yang diperlukan untuk memilih salah satu dari 12 opsi seperti memilih sebulan dalam setahun atau sebagai hasil dari gulungan 12 aspek.

- Dia – dia Tidak cukup untuk menyimpan bahkan satu bahasa Inggris (yang membutuhkan sekitar 4,7 bit), Tetapi cukup untuk menyembuhkan surat dari kelompok yang dikurangi dari 10 bahasa Inggris umum (yang membutuhkan sekitar 3,32 bit).

- Dalam panel, 3,6 bit adalah 0,45 byte – kurang dari setengah ukuran huruf khas yang disimpan dalam ASCII (yang digunakan 8 bit atau 1 byte).

Jumlah ini tidak tergantung pada model dalam perbedaan arsitektur yang masuk akal: kedalaman yang berbeda, menampilkan, dan akurasi yang menghasilkan hasil yang sama. Perkiraan tetap stabil melalui ukuran model dan bahkan tingkat akurasi, dengan model akurasi penuh mencapai nilai yang sedikit lebih tinggi (hingga 3,83 bit/parameter).

Lebih banyak data pelatihan tidak mengarah pada lebih banyak hafalan – pada kenyataannya, itu akan menjadi formulir Lebih sedikit Untuk menyimpan satu titik data

Salah satu makanan utama pencarian adalah bahwa model tidak menghemat lebih banyak ketika mereka dilatih dalam lebih banyak data. Sebaliknya, kapasitas tetap model didistribusikan melalui kumpulan data, yang berarti bahwa setiap titik data individu kurang mendapat perhatian.

Jack Morris, penulis utama, Penjelasan melalui jejaring sosial x “Pelatihan tentang lebih banyak data akan memaksa model untuk menghemat lebih sedikit untuk setiap sampel.”

Hasil ini dapat membantu mengurangi kekhawatiran tentang model besar yang menjaga konten hak cipta atau sensitif.

Jika pelestarian terbatas dan dikurangi melalui banyak contoh, kemungkinan mengkloning setiap pelatihan spesifik berkurang. Intinya, lebih banyak data pelatihan mengarah pada perilaku generalisasi yang lebih aman, bukan peningkatan risiko.

Bagaimana para peneliti mengidentifikasi hasil ini

Untuk secara akurat menentukan jumlah model bahasa, para peneliti menggunakan pendekatan yang tidak konvensional tetapi kuat: Mereka melatih model transformator pada set data bitstings yang seragam. Sampel diambil dari masing -masing bit ini secara independen, memastikan bahwa tidak ada pola, struktur atau pengulangan melalui contoh.

Karena setiap sampel unik bebas dari fitur umum, yaitu, kemampuan untuk menunjukkan model dalam Mencerminkan rekonstruksi atau identifikasi rantai ini selama evaluasi secara langsung jumlah informasi yang mereka simpan – atau disimpanPelatihan.

Alasan utama untuk pengaturan ini sepenuhnya menghilangkan kemungkinan generalisasi. Berbeda dengan bahasa alami – yang penuh dengan struktur tata bahasa, gangguan semantik, dan konsep yang diulang – data acak tidak mengandung informasi tersebut. Setiap contoh terutama noise, tanpa hubungan statistik dengan hubungan lain. Dalam skenario seperti itu, kinerja apa pun harus datang sesuai dengan formulir pada data pengujian dari menghafal contoh pelatihan, karena kurangnya pola distribusi yang harus diedarkan dari.

Penulis berpendapat bahwa cara mereka mungkin Salah satu satu -satunya cara awal untuk memisahkan menghafal dari pembelajaran Dalam praktiknya, karena ketika LLMS dilatih dalam bahasa nyata, bahkan ketika hasil dihasilkan yang cocok dengan data pelatihan, sulit untuk mengetahui apakah Anda telah menyimpan input atau hanya menyimpulkan struktur dasar dari pola yang mereka perhatikan.

Metode ini memungkinkan para peneliti untuk menetapkan hubungan langsung antara jumlah parameter model dan total informasi yang disimpan. Dengan meningkatkan ukuran model dan melatih setiap variabel ke saturasi, melalui ratusan percobaan pada model mulai dari 500 kilo hingga 1,5 miliar guru, perhatikan hasil yang konsisten: 3.6 bit dicadangkan untuk setiap guruYang mereka laporkan sebagai ukuran dasar kapasitas memori LLM.

Tim menerapkan metodologinya pada model yang dilatih dalam koleksi data dunia nyata juga. Ketika pelatihan dalam teks, model menunjukkan keseimbangan antara menghafal dan generalisasi.

Koleksi data yang lebih kecil mendorong ukuran yang lebih besar, tetapi dengan meningkatkan ukuran kumpulan data, model telah beralih ke pola yang bersirkulasi. Transisi ini ditandai dengan fenomena yang dikenal sebagai “pendaratan ganda”, karena kinerja menurun sementara sebelum perbaikan segera setelah surat edaran ditendang.

Studi ini juga mempelajari bagaimana akurasi khas – pelatihan dalam bfloat16 versus float32 – mengarah pada kemungkinan pelestarian. Perhatikan peningkatan sederhana dari 3,51 menjadi 3,83 bit untuk setiap guru saat beralih ke resolusi 32 -bit penuh. Namun, keuntungan ini jauh lebih rendah daripada dua kali lipat bit yang tersedia yang menunjukkannya, yang berarti mengurangi pengembalian dari akurasi atas.

Data unik kemungkinan akan disimpan

Makalah ini mengusulkan undang -undang pembatasan yang terkait dengan kapasitas model dan ukuran data yang ditetapkan untuk secara efektif.

Serangan -serangan ini mencoba menentukan apakah titik data tertentu adalah bagian dari set pelatihan model. Penelitian menunjukkan bahwa serangan semacam itu menjadi tidak dapat diandalkan dengan pertumbuhan kumpulan data, yang mendukung argumen yang secara luas membantu mengurangi risiko privasi.

Sementara makalah ini berfokus pada perilaku Negara Bagian Tengah, beberapa peneliti telah mengindikasikan bahwa jenis data tertentu-seperti menulis yang sangat unik atau logis-masih lebih mungkin dilestarikan.

Para penulis mengakui pembatasan ini dan menekankan bahwa cara mereka dirancang untuk mengkarakterisasi tren publik alih -alih kasus tepi.

Bergerak menuju pemahaman manusia yang lebih besar tentang pemahaman LLM

Dengan memberikan definisi awal dan terukur, penelitian ini memberi pengembang dan peneliti alat baru untuk menilai perilaku model bahasa. Ini tidak hanya dengan transparansi yang khas, tetapi juga dengan kepatuhan, privasi dan standar moral dalam mengembangkan kecerdasan buatan. Hasilnya menunjukkan bahwa lebih banyak data-tidak kurang mungkin menjadi jalur paling aman ketika model bahasa dilatih secara luas.

Untuk menempatkan total bentuk bentuk dalam perspektif:

- Model parameter dapat menghemat 500 km sekitar 1,8 juta bit, atau 225 kilo data.

- Model parameter dapat berisi 1,5 miliar pada sekitar 5,4 miliar bit, atau 675MB informasi awal.

- Tidak dapat dibandingkan dengan menyimpan file model seperti gambar (misalnya, gambar 3,6MB adalah sekitar 30 juta bit), tetapi penting ketika didistribusikan melalui pola teks yang terpisah.

Saya bukan pengacara atau ahli hukum, tetapi saya berharap penelitian semacam itu disebutkan dalam banyak tuntutan hukum yang berkelanjutan antara penyedia kecerdasan buatan dan pencipta/pemegang hak data.

Tautan sumber

Berita

Trump mengatakan Iran tidak akan membuat bom untuk waktu yang sangat lama setelah serangan udara Amerika Serikat.

Kebijakan Iran Mendapat Badan Atom PBB

Setelah 12 hari pertempuran, Presiden Donald Trump dan Perdana Menteri Israel Benjamin Netanyahu mengumumkan kemenangannya atas program nuklir Iran.

Trump mengumumkan bahwa tiga situs nuklir telah dilenyapkan, ketika Netanyahu mengumumkan bahwa Israel “telah menghilangkan ancaman eksistensial langsung: bidang nuklir dan bidang rudal balistik” – pencapaian Badan Energi Internasional PBB (International Tiles Agency) gagal.

Dr. atau Rabinovich, seorang peneliti proliferasi nuklir dari Universitas Ibrani Yerusalem dan seorang profesor tamu di Universitas Stanford, mengatakan kepada Fox News Digitter bahwa Badan Energi Atom Internasional “tidak dapat, dengan sendirinya, mencegah negara yang ingin mengkonversi bahan nuklir dan teknologi dari program sipilnya menjadi program militernya.”

“Dia bisa memperingatkan, dan inilah yang dia lakukan,” katanya. “Kadang -kadang, peringatan ini mengarah pada resolusi Dewan Keamanan PBB, dan kadang -kadang tidak melakukannya, tetapi Badan Energi Atom Internasional itu sendiri, itu tidak dapat berbuat lebih banyak – itu kuat seperti anggota Dewan Direksi dan negara -negara tempat Anda berpartisipasi.”

Beberapa hari sebelum Israel meluncurkan serangan militernya terhadap Iran dengan tujuan menghilangkan ancaman senjata nuklir dan tradisional, pengamat nuklir global menyatakan bahwa Iran memiliki sekitar 408,6 kg (sekitar 901 pound) uranium yang diperkaya hingga 60 %, cukup untuk memproduksi beberapa album nuklir.

Laporan itu, yang juga mengkritik kurangnya kerja sama Iran dengan Badan Energi Atom Internasional, mendorong Dewan Gubernur Agensi, untuk pertama kalinya dalam 20 tahun, bahwa Republik Islam itu melanggar kewajibannya selain penyebaran.

“Kita seharusnya tidak terkejut dengan kegagalan ini, dan kita harus menambah kegagalan ini, kegagalan PBB,” kata Dr. Yuel Josensky, seorang kolega yang lebih tua di Institut Studi Keamanan Nasional di Universitas Tel Aviv. Josensky menyoroti fakta bahwa hanya satu minggu yang lalu, di tengah peluncuran ratusan rudal balistik ke kota -kota dan kota -kota Israel, Menteri Luar Negeri Iran Abbas Aragchai berbicara kepada Dewan Hak Asasi Manusia PBB di Jenewa.

Dia menunjukkan bahwa “Iran disambut di sana, dan Israel dipukuli.” “Ini hanya menunjukkan bahwa sistem PBB telah lama gagal, dan lama perlu dibentuk kembali, membangun kembali dan membangun kembali,” lanjut Josensky, menambahkan bahwa, dibandingkan dengan badan -badan PBB lainnya, “Badan Energi Atom Internasional agak baik.”

“Ini bukan hitam dan putih, itu telah membuat beberapa pencapaian, tetapi itu tergantung pada apa harapan Anda.” “Saya tidak berpikir ada yang mengharapkan Badan Energi Atom Internasional untuk mencegah Iran sepenuhnya.”

Josensky mengatakan bahwa dua dekade inspeksi dan laporan semacam itu telah memungkinkan Israel dan Amerika Serikat untuk “mengumpulkan intelijen dan memahami program nuklir Iran” – sebuah fakta yang telah diuji selama satu setengah minggu terakhir.

Iran terus -menerus mengkonfirmasi bahwa semua kegiatan nuklirnya benar -benar damai dan tidak akan pernah berusaha untuk mengembangkan atau mendapatkan senjata nuklir. “Masalah sebenarnya di sini belum tentu Badan Energi Atom Internasional, Iran telah selingkuh selama 20 tahun dan tidak melakukan pemogokan lurus,” kata Alan Mendoza, CEO Asosiasi Henry Jackson.

Dia mengatakan: “Iran membingungkan, menipu dan mengembangkan program, yang tidak dapat dicapai oleh Badan Energi Atom Internasional, menambahkan,” oleh karena itu, dalam banyak hal, itu bukan kesalahan Badan Energi Atom Internasional, dengan sendirinya, tidak memiliki kemampuan penegakan – fungsinya hanyalah pemantauan. “

Ini adalah kutipan dari artikel

Ditulis oleh Fox News Ruth Marx Iglahas.

Berita

IBM percaya bahwa agen kelembagaan menggunakan “segalanya” ketika datang ke AI, dan tantangannya adalah pencocokan LLM dengan negara penggunaan yang benar

Bergabunglah dengan acara bahwa para pemimpin lembaga telah dipercaya selama hampir dua dekade. VB Transform menggabungkan orang yang membangun strategi AI untuk institusi nyata. Pelajari lebih lanjut

Selama seratus tahun terakhirDan SAYABm Banyak tren teknis yang berbeda telah terlihat meningkat dan jatuh. Yang cenderung menang adalah teknik di mana ada opsi.

di dalam VB mengonversi 2025 Hari ini, Armand Ruiz, Wakil -Kepala Platform Kecerdasan Buatan IBM secara rinci sejauh mana pemikiran biru yang hebat tentang kecerdasan buatan dan bagaimana pengguna institusi sebenarnya menerbitkan teknologi ini. Topik utama yang telah dikonfirmasi Ruiz adalah bahwa pada titik ini, ini bukan tentang memilih model atau teknik bahasa tunggal (LLM). Semakin banyak pelanggan institusional secara sistematis menolak strategi kecerdasan buatan untuk penjual tunggal yang mendukung beberapa model yang sesuai dengan LLM yang ditentukan dengan kasus penggunaan yang ditargetkan.

IBM memiliki model internasional Amnesty Open Source dengan keluarga granit, tetapi tidak menentukan pengembangan teknologi ini sebagai satu -satunya pilihan, atau bahkan opsi yang tepat untuk semua beban kerja. Perilaku lembaga ini mendorong IBM ke posisi itu sendiri tidak seperti pesaing model utama, tetapi sebagai Ruiz disebut sebagai menara kontrol untuk beban karya Amnesty International.

“Ketika saya duduk di depan pelanggan, mereka menggunakan semua yang dapat mereka capai, semuanya,” Ruiz menjelaskan. “Untuk pengkodean, mereka menyukai antropor dan beberapa kasus penggunaan lainnya seperti logika, mereka mencintai O3 dan kemudian untuk menyesuaikan LLM, dengan data mereka sendiri dan kontrol yang tepat, dan mereka menyukai rantai granit kami atau yang salah dengan model kecil mereka, atau bahkan Llama … itu hanya pertandingan LLM dengan penggunaan yang tepat. Lalu kami membantu mereka dengan baik.”

Strategi Gerbang Multi-Llm

Respons IBM terhadap kenyataan ini di pasar adalah gerbang model yang baru dirilis yang menyediakan lembaga untuk satu antarmuka pemrograman aplikasi untuk beralih antara LLM yang berbeda sambil mempertahankan pengamatan dan tata kelola melalui semua operasi penerbitan.

Arsitektur teknis untuk pelanggan memungkinkan pengoperasian model open source pada stapel inferensi mereka untuk situasi penggunaan sensitif dengan fasad pemrograman aplikasi publik satu kali seperti AWS Bedrock atau Google Cloud Gemini untuk aplikasi yang kurang penting.

“Gerbang ini memberi pelanggan kami satu lapisan dengan satu antarmuka aplikasi untuk beralih dari LLM ke LLM lain dan menambahkan pengamatan dan tata kelola sepanjang waktu,” kata Ruiz.

Pendekatan ini secara langsung kontras dengan strategi penjual bersama untuk menutup pelanggan di ekosistem khusus. IBM tidak sendirian dalam mengikuti pendekatan multi -leller untuk memilih model. Beberapa alat telah muncul dalam beberapa bulan terakhir untuk memandu model, yang bertujuan untuk mengarahkan beban kerja ke model yang sesuai.

Protokol komitmen muncul sebagai infrastruktur kritis

Selain manajemen multi -mode, IBM membahas tantangan yang muncul untuk berkomunikasi dari agen ke agen melalui protokol terbuka.

Perusahaan telah mengembangkan ACP (protokol koneksi agen) dan berkontribusi pada Linux Foundation. ACP adalah upaya kompetitif untuk Google Agent2agen (A2A), yang disumbangkan Google minggu ini di Linux.

Ruiz menunjukkan bahwa kedua protokol bertujuan untuk memfasilitasi komunikasi antar agen dan mengurangi pekerjaan pembangunan yang dialokasikan. Diharapkan bahwa berbagai metode saat ini berkumpul, saat ini, perbedaan antara A2A dan ACP sering menjadi teknologi.

Protokol konjungsi menyediakan cara terpadu sistem kecerdasan buatan untuk berinteraksi melalui platform dan penjual yang berbeda.

Pentingnya teknis menjadi jelas ketika mempertimbangkan skala lembaga: beberapa pelanggan IBM sudah memiliki lebih dari 100 agen dalam program eksperimental. Tanpa protokol komunikasi yang seragam, interaksi masing -masing agen membutuhkan agen pengembangan khusus, yang menciptakan beban integrasi yang tidak kompatibel.

Kecerdasan buatan berkisar pada transformasi tugas kerja dan cara pekerjaan dilakukan

Mengenai bagaimana Ruiz yang mempengaruhi lembaga yang mempengaruhi saat ini, ini menunjukkan bahwa itu harus lebih dari sekadar chatbots.

“Jika Anda hanya memberikan obrolan, atau Anda hanya mencoba melakukan biaya dengan kecerdasan buatan, Anda tidak melakukan kecerdasan buatan,” kata Ruiz. “Saya pikir kecerdasan buatan akan sepenuhnya mengubah alur kerja dan cara pekerjaan dilakukan.”

Perbedaan antara implementasi kecerdasan buatan dan AI berfokus pada kedalaman teknologi dalam proses komersial saat ini. Contoh Sumber Daya Manusia Internal IBM menunjukkan transformasi ini: alih -alih memiliki informasi sumber daya manusia, agen yang sekarang berurusan dengan informasi rutin tentang kompensasi, pekerjaan dan promosi, secara otomatis panduan ke sistem yang sesuai dan meningkatkan untuk manusia hanya jika diperlukan.

“Saya menghabiskan banyak waktu untuk berbicara dengan mitra sumber daya manusia saya untuk mendapatkan banyak hal. Saya berurusan dengan sebagian besar dari mereka sekarang dengan agen sumber daya manusia,” jelas Ruiz. “Berdasarkan pertanyaan, apakah itu terkait dengan kompensasi atau sesuatu yang hanya terkait dengan berurusan dengan pemisahan, mempekerjakan seseorang, atau membuat penawaran promosi, maka semua hal ini akan berkomunikasi dengan berbagai sistem sumber daya manusia internal, dan itu akan seperti agen terpisah.”

Ini adalah pergeseran arsitektur yang penting dari pola interaksi komputer manusia ke otomatisasi alur kerja yang terjadi oleh komputer. Alih -alih karyawan belajar berinteraksi dengan alat kecerdasan buatan, kecerdasan buatan belajar untuk melakukan bisnis penuh -ke -bagian.

Efek teknis: Lembaga perlu melampaui API dan rekayasa yang menuntut perangkat proses yang dalam yang memungkinkan agen kecerdasan buatan untuk melakukan tugas alur kerja multi -langkah secara mandiri.

Efek strategis dari investasi AI terhadap institusi

Data penerbitan realistis IBM menunjukkan banyak transformasi penting dari strategi AI yayasan:

Meninggalkan pemikiran chatbot pertamaLembaga harus menentukan tugas alur kerja lengkap untuk berubah alih -alih menambahkan antarmuka percakapan ke sistem saat ini. Tujuannya adalah untuk menghilangkan langkah -langkah manusia, tidak meningkatkan interaksi komputer manusia.

Arsitek untuk fleksibilitas multi -gaya: Alih -alih mematuhi penyedia kecerdasan buatan, lembaga membutuhkan platform integrasi yang memungkinkan pengalihan antara model berdasarkan persyaratan keadaan penggunaan sambil mempertahankan kriteria tata kelola.

Berinvestasi dalam Standar KomunikasiLembaga harus memberikan prioritas pada alat kecerdasan buatan yang mendukung protokol yang muncul seperti MCP, ACP dan A2A alih -alih metode integrasi kerajaan yang membuat kunci penjual.

“Ada banyak hal untuk konstruksi, dan saya masih mengatakan bahwa semua orang perlu belajar kecerdasan buatan, terutama para pemimpin bisnis, yang harus menjadi pemimpin internasional amnesti dan memahami konsep,” kata Ruiz.

Tautan sumber

Berita

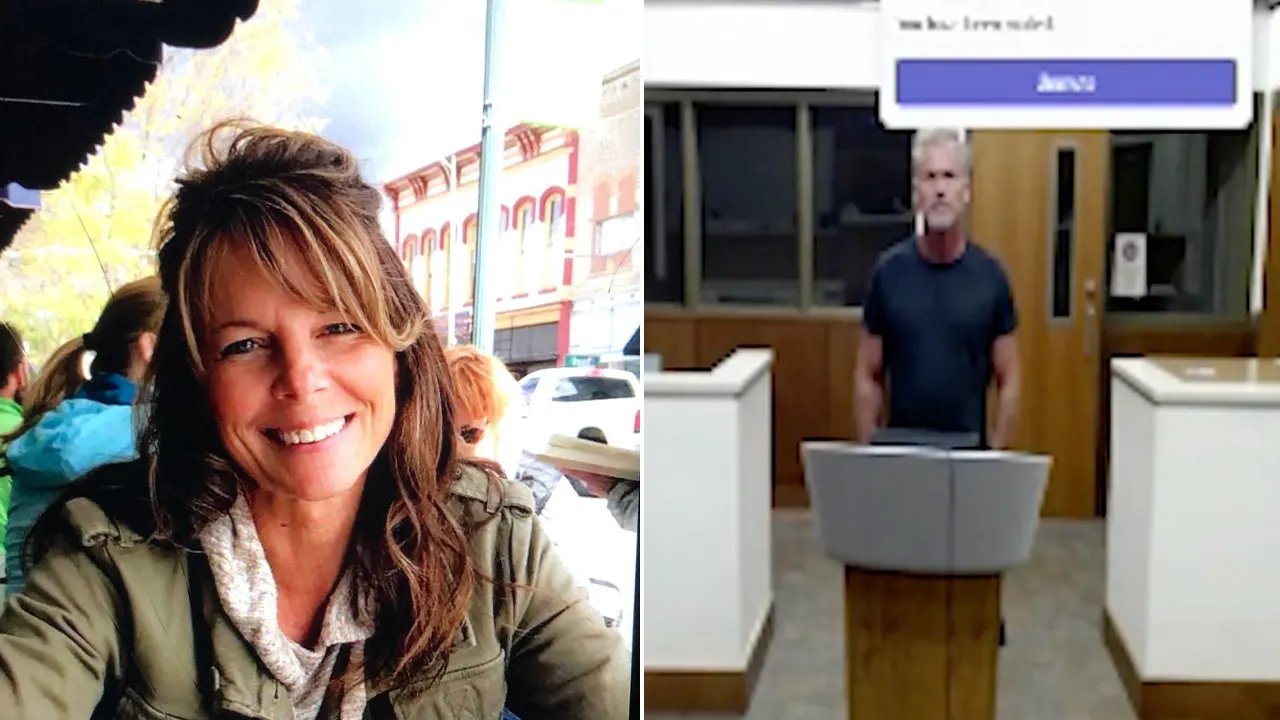

Barry Morveio mempertahankan paten untuk pembunuhan kelas pertama dari istri: pengacara

baruAnda sekarang dapat mendengarkan Fox News!

Pengacara Barry Morefio mengatakan kliennya “mempertahankan kepolosannya” setelah Murvio menuduh kematian kelas pertama atas kematian istrinya, Suzanne Morvio.

Dia ditangkap di dekat Veniz, Arizona, pada hari Jumat, setelah juri besar dituduh diduga membunuh istrinya, yang menghilang selama perjalanan sepeda Hari Ibu.

“Dia mempertahankan kepolosannya,” kata pengacara Murvio, David Biller, kepada Fox News Digital Morphew.

“Sekali lagi, pemerintah mengizinkan kesimpulan yang telah ditentukan sebelumnya untuk memimpin pencarian mereka untuk bukti,” kata Biller. “Kasus ini tidak berubah, dan hasilnya juga tidak akan berubah.”

Sisa -sisa Colorado kehilangan ibuku, Susan Morpio, ditemukan setelah tiga tahun menghilang

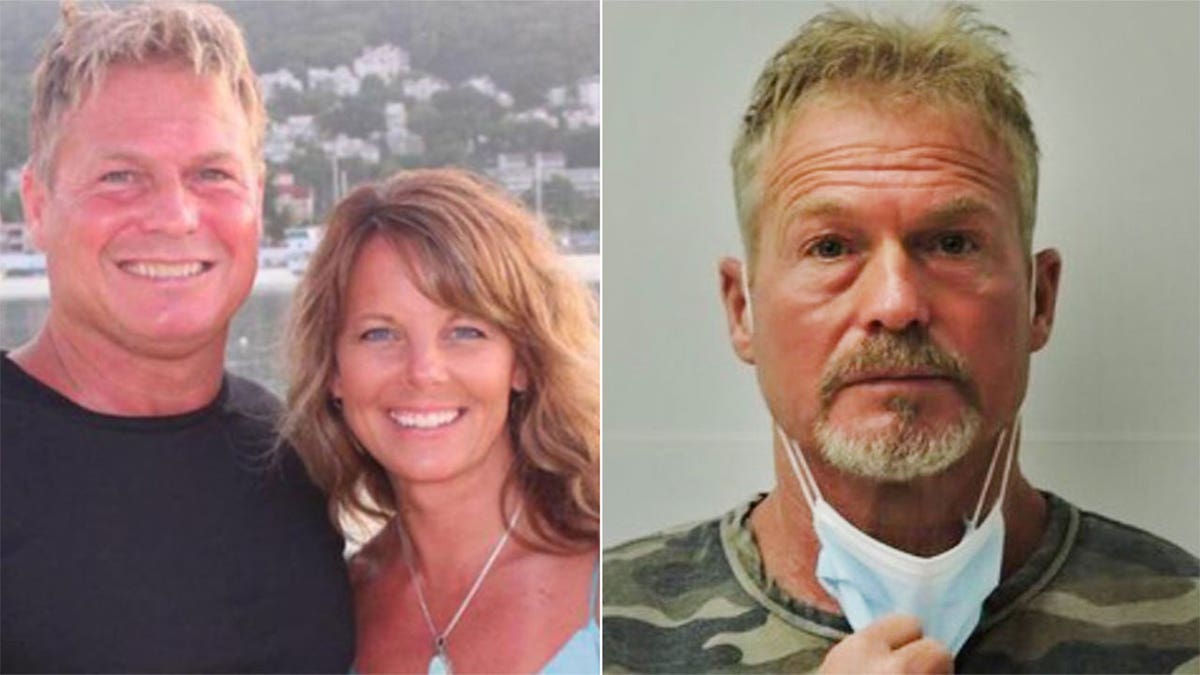

Suzan Morveio dan Barry Morveio (Kantor Sharif Shafi County dan Kantor Sharif Marikuba County)

Sisa -sisa Suzan Murphyo ditemukan oleh Biro Colorado pada tahun 2023 di provinsi Sagawash di bagian barat daya negara bagian.

Barry Morveio ditahan di penjara di Provinsi Mariakoba, Arizona, sementara ia diharapkan akan dikirim ke Colorado.

“Pengabaian,” kata Murvio di pengadilan ketika dia ditanya apakah dia menginginkan sesi pengiriman.

Menurut salinan peraturan tuduhan dewan juri, banyak tulang Susan Morveio ditemukan “sangat diputihkan” ketika jenazahnya ditemukan pada tahun 2023. Menurut dakwaan, jaksa penuntut mengatakan “tidak mungkin” bahwa tubuhnya akan membusuk menjadi kerangka di lokasi yang ditemukan.

Barry Morveio dituduh oleh dewan juri yang diduga membunuh istri yang menghilang pada Hari Ibu

Barry Morefio dituduh membunuh istrinya, Susan Morphyo. (AP)

Jaksa penuntut mengatakan bahwa bahan kimia yang meliputi Potorfanol, Azabiron dan Metomedin (BAM) ditemukan di dalam tubuh Susan Morpio. Menurut dakwaan, Barry Morefio menggunakan “BAM” sebagai ketenangan untuk membius dan mentransfer rusa Rusa.

Membaca Dakwaan

Sepeda Susan Morveio ditemukan pada hari ketika menghilang pada tahun 2020 di sepanjang lembah di sepanjang jalan raya ke -50 dan 225 provinsi di Kabupaten Shafi. Pada waktu itu, Barry Morveio bekerja di Bromfield, Colorado.

Pesan tekstual yang dipertukarkan antara Barry Morveio dan Susan Morphyo menunjukkan hubungan sebelum dia melewatkannya.

Empat hari sebelum dia menghilang, Susan Morveio mengirim pesan teks yang dia katakan “selesai.”

“Saya bisa peduli dengan apa yang Anda jangkau dan apa yang telah saya lakukan selama bertahun -tahun,” katanya, menambahkan bahwa mereka membutuhkan “Kodley” untuk menemukan sesuatu.

Klik di sini untuk mendapatkan aplikasi Fox News

Dalam gambar video yang tetap ini, Barry Morveio, sebuah pusat, muncul di pengadilan di Salida, Colorado, 6 Mei. (Kusa via AP, kolam renang)

Barry Morpio mengajukan gugatan $ 15 juta pada tahun 2023 terhadap jaksa penuntut dan penyelidik, mengklaim bahwa mereka telah melanggarnya Hak konstitusional.

“Barry adalah yang paling banyak diperiksa, anatomi, dan otopsi, akurat, sepanjang waktu, menggunakan kamera penegak hukum bahwa rumahnya, tap telepon dan perangkat GPS ditempatkan di mobilnya – semua selama garis waktu lenyap dan tahun -tahun berikutnya,”

Di bawah Konklin di Audrey News berkontribusi pada laporan ini.

Berita8 tahun ago

Berita8 tahun agoThese ’90s fashion trends are making a comeback in 2017

Berita8 tahun ago

Berita8 tahun agoThe final 6 ‘Game of Thrones’ episodes might feel like a full season

Berita8 tahun ago

Berita8 tahun agoAccording to Dior Couture, this taboo fashion accessory is back

Berita8 tahun ago

Berita8 tahun agoThe old and New Edition cast comes together to perform

Berita8 tahun ago

Berita8 tahun agoPhillies’ Aaron Altherr makes mind-boggling barehanded play

Berita8 tahun ago

Berita8 tahun agoUber and Lyft are finally available in all of New York State

Berita8 tahun ago

Berita8 tahun agoDisney’s live-action Aladdin finally finds its stars

Berita8 tahun ago

Berita8 tahun agoSteph Curry finally got the contract he deserves from the Warriors